Линейна регресия — понятие, методи и практически приложения

Линейна регресия: концепции, методи и практични приложения за прогнозиране, оценка на връзки между променливи и оптимизиране на модели — практическо ръководство за анализ.

Линейната регресия е метод за количествено описание на връзката между една зависима променлива и една или повече обяснителни променливи, използвайки линейна функция. Типичният вид на прост линеен регресионен модел е: y = β0 + β1·X + ε, където β0 е свободният член (интерсепт), β1 е коефициентът на наклон (ефектът на X върху y), а ε представлява случайна грешка или остатък. Моделът дава линия на регресия, която преминава приблизително през множеството наблюдения и служи за обобщаване на тяхната зависимост.

Основни понятия

Линейната регресия използва зависима променлива и една или повече обяснителни променливи, за да се създаде права линия. Това е първият от многото подходи при регресионния анализ, тъй като модели, които зависят линейно от параметрите си, се подбират и анализират по-лесно в сравнение с нелинейните. Освен удобството при оценяване, линейната регресия често дава интерпретируеми параметри — единствено изместване или промяна на единица в X съответства на β1 единици промяна в y (при всички останали условия равни).

Типове линейни модели

- Проста линейна регресия — съдържа една обяснителна променлива X и описва връзката y ~ β0 + β1·X.

- Множествена линейна регресия — включва няколко променливи X1, …, Xp и моделът е y ~ β0 + β1·X1 + … + βp·Xp. Тя позволява да се оцени количествено силата на връзката между y и всяка Xj и да се идентифицират променливи, които нямат значим принос.

Оценяване: метод на обикновените най-малки квадрати (OLS)

Най-често използваният метод за напасване на линейни модели е методът на най-малките квадрати, който минимизира сумата от квадратите на вертикалните остатъци (разликите между наблюдаваните и предсказаните стойности). В резултатите се получават оценки за параметрите β, за които има добре разработена теория — например, при спазване на предпоставките оценките са несместни, ефективни и асимптотично нормални.

Предпоставки на класическия линеен модел

- Линейност: средната стойност на y за дадени X е линейна във параметрите.

- Независимост: наблюденията (и грешките ε) са независими едно от друго.

- Хомоскедастичност: дисперсията на грешките е константна за всички стойности на X.

- Нормалност (за инференция): грешките ε са приблизително нормално разпределени (не е задължително за оценките, но е полезно за тестове и доверителни интервали при малки проби).

- Липса на идеална мултиколинеарност: обяснителните променливи не са точни линейни комбинации една на друга.

Диагностика и ключови показатели

- R² — делът от вариацията на y, обяснен от модела; показва каква част от изменчивостта се улови, но расте при добавяне на променливи (алтернативно използвайте прецизиран R²).

- Остатъци — проверка за моделиране на зависимостите (системни шаблони, нелинейности) чрез графики: остатъци спрямо предсказани, квантил-квантил (QQ) графики за нормалност.

- t-тестове и p-стойности — за проверка на значимостта на отделни коефициенти.

- F-тест — за цялостната значимост на модела.

- Проблеми като мултиколинеарност (например високи стойности на VIF), автокорелация (Durbin–Watson тест) и хетероскедастичност (Breusch–Pagan, White тест) трябва да се диагностицират и поправят при нужда.

Регуляризация и разширения

При много променливи или когато се желае намаляване на overfitting се прилагат методи, които штрафуват големи коефициенти, като ridge регресия (гребен) и lasso. Тези техники минимизират наказана версия на функцията за загуба на най-малките квадрати и често дават по-стабилни предсказания при висока колинеарност или ограничени проби. Други разширения включват регресия със сменлива трансформация, полиномиални термини и модели с взаимодействия между променливите.

Предсказване срещу инференция

Линейната регресия се използва както за предсказване (предвиждане на бъдещи стойности на y при нови X), така и за причинно-инференциални изводи (оценка на ефекта на конкретна променлива върху y). За предсказване основният интерес е минимизиране на грешката на прогнозата; за инференция е важно да са спазени предпоставките на модела и да се контролира за конфундиращи фактори.

Практически приложения

- Икономика: прогнозиране на разходи, приходи, търсене и анализ на въздействие на политики.

- Маркетинг: оценка на ефекта на реклама върху продажби, моделиране на цена — обем.

- Наука и инженерство: анализ на експериментални данни, калибриране на уреди, прогнозиране на резултати.

- Здравеопазване: асоциации между рискови фактори и здравни изходи (когато се вземат предвид потенциалните конфундатори).

В контекста на практическите приложения често се прилагат два основни подхода:

- Линейната регресия може да се използва за приспособяване на прогнозен модел към набор от наблюдавани стойности (данни). Това е полезно, ако целта е предвиждане, прогнозиране или намаляване. След разработването на такъв модел, ако след това се даде допълнителна стойност на X без придружаващата я стойност на y, напаснатият модел може да се използва, за да се направи прогнозна стойност на y (записана като

- При дадена променлива y и редица променливи X1 , ..., Xp , които могат да бъдат свързани с y, може да се приложи линеен регресионен анализ, за да се определи количествено силата на връзката между y и Xj , да се оцени коя Xj изобщо няма връзка с y и да се определи кои подмножества на Xj съдържат излишна информация за y.

Ограничения и добри практики

- Линейният модел може да бъде неадекватен при силно нелинейни зависимости — разгледайте трансформации (логаритъм, полиноми) или нелинейни модели.

- Когато има хетероскедастичност или автокорелация, стандартните грешки и тестове могат да бъдат подвеждащи — използвайте коригирани стандартни грешки или модели, пригодени за зависимостта (например ARIMA за времеви редове).

- Проверявайте данните за изключения (outliers) и влиятелни наблюдения (Cook’s distance) — те могат да изкривят оценките на модела.

- При интерпретация на коефициенти в множествен модел, помнете, че те са условни на останалите променливи в модела.

Софтуер и инструменти

Линейната регресия е налична във всички широко използвани статистически и програмни среди: R (lm, glmnet), Python (statsmodels, scikit-learn), Stata, SAS, SPSS и други. Прилагайте подходяща валидация (например кръстосана валидация) при изграждане на предсказателни модели и документире добре стъпките по предпроцесинг, избор на променливи и диагностика.

В обобщение, линейната регресия е мощен и лесен за тълкуване инструмент за моделиране и предсказване, но резултатите са надеждни само ако се проверят предпоставките, се извърши адекватна диагностика и се вземат мерки при наличие на проблеми като мултиколинеарност, хетероскедастичност или нелинейности.

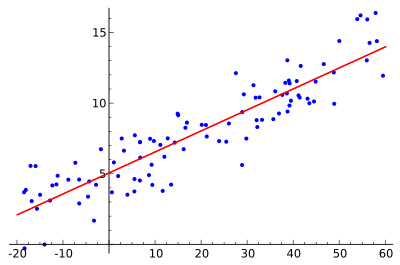

Идеята е да се намери червената крива, а сините точки са действителните проби. При линейната регресия всички точки могат да се свържат с помощта на една права линия. В този пример се използва проста линейна регресия, при която квадратът на разстоянието между червената линия и всяка точка от извадката се минимизира.

Употреба

Икономика

Линейната регресия е основният аналитичен инструмент в икономиката. Например тя се използва за прогнозиране на разходите за потребление, разходите за инвестиции в основен капитал, инвестициите в материални запаси, покупките на износа на дадена страна, разходите за внос, търсенето на ликвидни активи, търсенето и предлагането на труд.

Свързани страници

- Подходяща крива

- Логистична регресия

- Обикновени най-малки квадрати

Въпроси и отговори

В: Какво представлява линейната регресия?

О: Линейната регресия е начин за разглеждане на това как нещо се променя, когато други неща се променят, като се използва математика. Тя използва зависима променлива и една или повече обяснителни променливи, за да създаде права линия, известна като "линия на регресия".

В: Какви са предимствата на линейната регресия?

О: Моделите, които зависят линейно от неизвестните си параметри, се подбират по-лесно, отколкото моделите, които са нелинейно свързани с параметрите си. Освен това статистическите свойства на получените оценки се определят по-лесно.

В: Какви са някои практически приложения на линейната регресия?

О: Линейната регресия може да се използва за напасване на прогностичен модел към наблюдаваните стойности (данни), за да се направят прогнози, предвиждания или намаления. Тя може да се използва и за количествено определяне на силата на връзките между променливите и за идентифициране на подмножества от данни, които съдържат излишна информация за друга променлива.

Въпрос: Как линейните регресионни модели се опитват да минимизират грешките?

О: Линейните регресионни модели се опитват да направят вертикалното разстояние между линията и точките от данни (остатъците) възможно най-малки. Това се постига чрез минимизиране на сумата от квадратите на остатъците (най-малки квадрати), липса на съответствие в някаква друга норма (най-малки абсолютни отклонения) или минимизиране на наказана версия на функцията за загуба на най-малките квадрати (регресия на гребена).

Въпрос: Възможно ли е моделите на линейна регресия да не се основават на най-малките квадрати?

О: Да, възможно е моделите на линейна регресия да не се основават на най-малките квадрати, а вместо това да се използват методи като минимизиране на липсата на съответствие в някаква друга норма (най-малки абсолютни отклонения) или минимизиране на наказана версия на функцията за загуба на най-малките квадрати (регресия на гребена).

Въпрос: Синоними ли са понятията "линеен модел" и "най-малки квадрати"?

О: Не, те не са синоними. Въпреки че са тясно свързани, "линеен модел" се отнася конкретно за използването на права линия, докато "най-малки квадрати" се отнася конкретно за опитите да се минимизират грешките, като се гарантира, че има минимално вертикално разстояние между линията и точките с данни.

обискирам